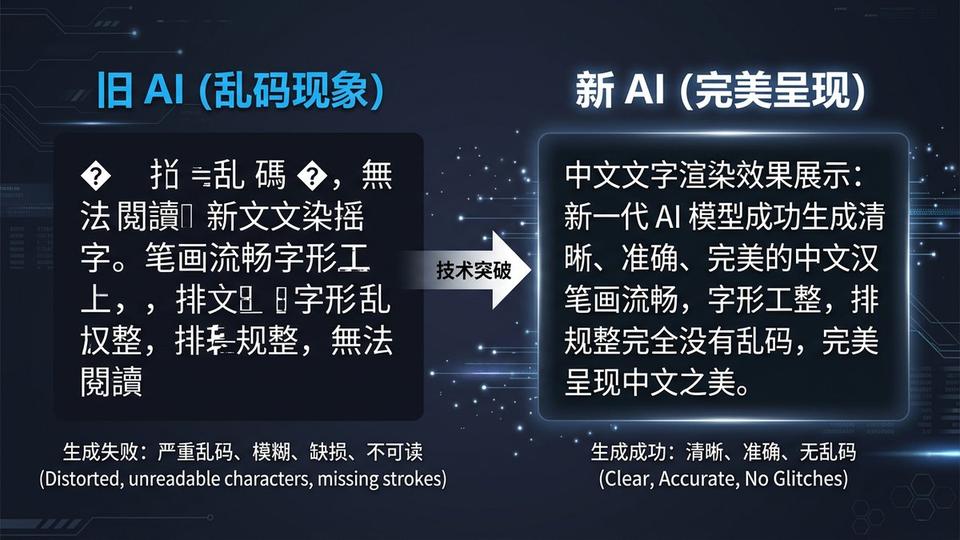

你让 AI 画一张中文海报,上面写"新品首发,限时特惠"。

结果出来一看——"新昴首友,陘旹特蕙"。

这个场景,过去两年做过 AI 生图的人应该都经历过。不管你用 DALL-E、Midjourney 还是 Stable Diffusion,中文文字渲染就是一个玄学。能出对字算运气好,出错才是常态。你能做的只有一件事:P图。

4 月 21 日,OpenAI 发了 GPT-image-2。

一句话说清楚:它到底新在哪

过去的 AI 画图,不管是 DALL-E 还是 Midjourney,核心都是扩散模型——往一张噪声图上"去噪",一步步还原出图像。你可以理解为,它在"碰运气"。碰对了就好看,碰错了就鬼畜。

GPT-image-2 换了赛道。

它用的是自回归架构,就是 GPT 生成文字的那套逻辑——一个 token 一个 token 地预测下一步。更关键的是,OpenAI 把 O 系列的推理引擎直接塞了进去。

生成之前,先规划构图、布局、元素位置;生成过程中,自我验证、发现错误就回头纠正。这是业界第一个把推理引擎原生集成进图像生成的模型。

它有两个模式:

- 即时模式:3 秒出图,适合快速迭代

- 思考模式:引入推理链甚至网页搜索,适合复杂场景

3 秒。上一代 DALL-E 3 要 20-45 秒。

从"画图"到"想清楚再画":技术哲学的转变

为什么要聊"架构转变"这件事?因为它决定了 AI 图像生成接下来几年的走向。

扩散模型的问题在于:它本质上是全局性的。整张图一起去噪,元素之间的关系全靠训练数据里的统计关联来保证。所以你让它画"一个人左手拿咖啡,右手拿手机",它经常搞反。让它画"六个手指",那就更是经典meme了。

自回归 + 推理的组合为什么能解决这些问题?

因为它在生成每一部分之前,先"想"过了。布局在哪、文字放在哪个位置、比例怎么分配——这些决策在像素开始生成之前就已经完成了。生成过程中如果发现前面画错了,还能回头修。

这像什么?

像一个画家和一个设计师的区别。扩散模型是画家——凭感觉、凭手感、凭训练出来的肌肉记忆往上画。自回归+推理是设计师——先看brief,画草稿,定版式,标注好文字位置,确认没问题,再开始精修。

结果的差距是碾压级的。 据多个测评报告,GPT-image-2 在 Text-to-Image 排行榜上领先第二名 242 分。这个分差在以往的模型迭代中几乎没出现过。

中文海报,终于不用 P 图了

说完技术,说最实际的东西。

注意,这个数字来自多个独立测评报告,而非 OpenAI 官方发布的 benchmark。但从大量实测案例来看,中文、日文、韩文的精准渲染确实是 GPT-image-2 最直观的突破。

做过电商的人都知道这意味着什么。

以前你要出一张中文促销海报,流程是这样的:AI 生成背景图 → Photoshop 加文字 → 调字体调排版 → 导出。AI 那张图只是个"底图",文字部分完全手工。

现在的流程:描述你要什么 → 出图 → 用。

一步到位。中间那些P图的环节,省了。

这对中文互联网的内容创作者来说是个实质性的里程碑。DALL-E 时代的"中文乱码"不是小毛病——它直接把 AI 生图从"能用"打成了"不能用"。你总不能在公众号封面图上放一行乱码。

再说另外两个实操层面的升级:

原生 4K 分辨率(4096×4096),支持 3:1 到 1:3 任意比例。 上一代 DALL-E 3 最高只有 1792×1024。这意味着 GPT-image-2 生成的图可以直接用在印刷场景——海报、展架、杂志封面,不用再拉伸或超分。

局部重绘能力大幅提升。 它用的是"两栏逻辑"——你指定要改的区域,它精准替换目标内容,背景保持原样,没有重影、没有接缝。以前局部重绘最头疼的就是改完后背景跟着变,现在这个问题基本解决了。

四代对比,一张表说清楚

| 维度 | DALL-E 3 | gpt-image-1/1.5 | GPT-image-2 |

|---|---|---|---|

| 架构 | 扩散模型 | 原生多模态(GPT-4o) | 推理增强自回归 |

| 生成速度 | 20-45 秒 | — | 约 3 秒 |

| 文字渲染 | 弱,中文不可用 | 约 90-95% | 约 99% |

| 最大分辨率 | 1792×1024 | — | 4096×4096 |

| 局部重绘 | 基础 | 改善 | 两栏逻辑,背景保真 |

| 推理能力 | 无 | 无 | O 系列推理引擎 |

三代产品,三个时代。DALL-E 3 是"能画",gpt-image-1 是"画得像样",GPT-image-2 是"想清楚再画"。

竞品格局:各有各的活法

| 模型 | 核心优势 | 短板 |

|---|---|---|

| GPT-image-2 | 实用性最强,文字渲染 99%,API+企业版齐全 | 价格贵,审美偏"实用" |

| Midjourney v7 | 审美上限最高,艺术风格突出 | API 受限,文字渲染差 |

| SD 3.5 | 开源自由,ControlNet/LoRA 精调 | 门槛高,需自建算力 |

| Imagen 3 | 极致真实感,Vertex AI 集成 | 生态相对封闭 |

简单说:如果你要审美天花板,选 Midjourney;如果你要自由度,选 SD;如果你要商业落地、快速出活,GPT-image-2 目前是最实际的选择。

部分设计师提出了一个有意义的批评:GPT-image-2 在遵循品牌 VI 的精确度上还有差距。你给它一套品牌色板和字体规范,它不一定能严格按规范来。对于大品牌的标准化视觉产出,人工设计师目前还是不可替代的。

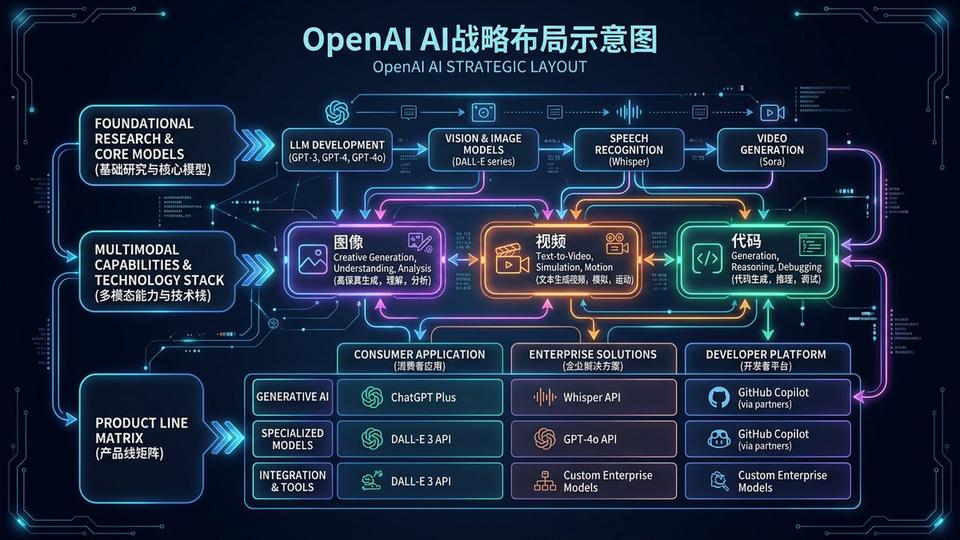

Sora 被砍,图像杀出来了

这里插一个值得关注的商业信号。

OpenAI 已官宣砍掉 Sora(视频生成),将资源重注到图像商业化上。

这个选择耐人寻味。

Sora 发布时声量很大,但商业化进展一直不顺——成本高、生成慢、可控性差、版权问题复杂。相比之下,图像生成的商业路径要清晰得多:电商需要产品图,营销需要海报,UI 设计需要原型,这些都是已经被验证过的付费场景。

OpenAI 选择在视频和图像之间做取舍,说明一件事:当资源有限时,先打能赢的仗。

定价:贵了一倍,但账要这么算

| 项目 | 价格 |

|---|---|

| 图像输入 | $8.00 / 1M tokens |

| 图像输入(缓存) | $2.00 / 1M tokens |

| 图像输出 | $30.00 / 1M tokens |

| 文本输入 | $5.00 / 1M tokens |

| Batch API | 减半(省 50%) |

图像输出 $30/1M tokens,比上一代贵了一倍。

贵吗?绝对值上肯定贵。但要算综合账:

以前:AI 生图 + 人工 P 文字 + 反复修改 = 总成本不低

现在:AI 一步出图 + 直接可用 = 总成本可能更低

对于电商场景,一张产品图从"出底图"到"能用"的时间从小时级压缩到秒级,省下的人力成本远超 token 费用的涨幅。

对于高频调用的企业,Batch API 省 50% 是关键。

API 调用有两种方式:

- Responses API(推荐):支持多模态链式工具调用

- Images API:直接图像生成,适合简单场景

对创作者和开发者意味着什么

如果你是内容创作者 / 设计师:

工具变强了,但你的核心价值没变。GPT-image-2 能快速出图、精准渲染文字、局部重绘,这些都是"执行层"的提效。但审美判断、品牌理解、创意策划——这些"决策层"的能力,AI 目前还替不了。

Gizmodo 批评说这是"AI Slop 的文艺复兴",PANews 说"设计师生计面临威胁"。两个说法都有道理,但都不完整。更准确的描述是:执行门槛降低了,审美门槛反而提高了。

如果你是开发者 / 技术负责人:

值得认真评估是否把 GPT-image-2 接入你的产品。适合的场景:

- 电商:产品图批量生成、背景替换

- 营销:多语种海报、社交媒体素材快速迭代

- UI/UX:原型图快速生成

- 虚拟试穿:服装电商的刚需

最后说一句

GPT-image-2 不是"AI 画图又进步了一点点"。

当一个模型开始在画之前先想、画的过程中会检查、发现错了能回头改——这件事的意义不止于出图质量的提升,它重新定义了 AI 和视觉创作之间的关系。

至于它到底能不能替代设计师?

别想这个问题了。更有意义的问题是:你打算怎么用它。